最近更新时间:2026-04-27 10:21:13 来源:51DNS.COM

在Kubernetes集群中,K8s DNS是保障服务间正常通信的核心组件,一旦出现故障,会直接导致Pod、Service之间无法正常寻址,引发业务中断。很多运维人员在遇到K8s DNS问题时,常因排查思路不清晰而耗费大量时间。那么,K8s DNS的故障都有哪些类型呢?又该如何进行排除呢?

1、Service域名解析失败

这是K8s DNS最常见的故障之一,主要表现为Pod内无法通过Service的域名访问对应服务,直接影响跨Pod的业务通信。故障原因可能涉及Service配置错误、K8s DNS组件未正常同步Service信息,或者Pod的DNS配置异常等。

2、外部域名解析超时

部分场景下,Pod内可以正常解析集群内部的Service域名,但无法解析集群外的公网域名,比如无法访问云服务商的存储服务或者第三方API。这类故障通常和K8s DNS的上游DNS配置、集群网络出口策略有关。

3、K8s DNS组件自身异常

K8s DNS组件本身出现故障,比如CoreDNS或kube-dns的Pod处于CrashLoopBackOff状态,或者组件进程无响应,会导致整个集群的域名解析服务全面瘫痪,影响所有依赖K8s DNS的业务。

1、检查K8s DNS组件Pod状态

通过kubectl命令查看kube-system命名空间下的K8s DNS相关Pod,比如CoreDNS Pod的运行状态、重启次数和日志信息。如果Pod处于异常状态,比如CrashLoopBackOff,可通过查看Pod日志定位具体错误,比如配置文件语法错误、资源不足导致OOM等。

2、验证K8s DNS Service可用性

K8s DNS组件自身也以Service的形式存在于集群中,可在集群内的测试Pod中,通过ping或nslookup命令测试K8s DNS Service的IP是否可达,同时验证其解析功能是否正常,比如解析一个已知的Service域名,确认返回结果是否符合预期。

1、检查Pod的DNS配置参数

每个Pod的/etc/resolv.conf文件中包含了K8s DNS的配置信息,可通过kubectl exec命令进入Pod内部查看该文件,确认nameserver是否指向K8s DNS Service的IP,search域是否配置正确。如果该文件配置异常,会直接导致Pod无法正常使用K8s DNS服务。

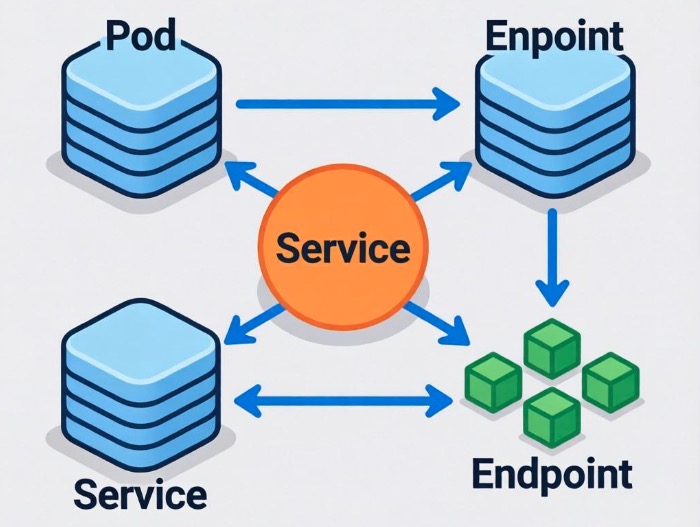

2、验证Service与Endpoints同步状态

K8s DNS是通过Endpoints获取Service对应的Pod IP信息的,若Service对应的Endpoints为空,或者Endpoints信息未同步到K8s DNS组件,就会导致解析失败。可通过kubectl get endpoints命令查看目标Service的Endpoints状态,确认是否有正常的Pod IP注册。

3、测试集群网络连通性

排除配置问题后,需要验证Pod与K8s DNS Pod之间的网络连通性,可在测试Pod中通过telnet命令测试K8s DNS Pod的53端口(UDP和TCP协议)是否能正常访问。如果网络不通,可能涉及网络策略、防火墙规则或者CNI插件的配置限制。